摘要:2025年,生成式人工智能(Generative AI)正以前所未有的速度推动内容创作进入全新阶段。从最初的文生图到如今一键生成完整动画剧集,技术迭代的能量已经全面冲击传统工作流。以Showrunner.ai为代表的新一代创作平台,不仅揭示了这场革命的核心驱动力,还孕育出“可玩电视”(Playable TV)等新兴概念,重新定义了叙事的边界与生态。与此同时,这股浪潮正在现实中深刻改变影视产业链的成本与周期,并在不同文化背景下重塑观众的参与方式和娱乐体验。然而,生产力的释放也伴随着复杂的社会议题:知识产权的归属、收益分配的公平,以及各国在法律、伦理与政策层面的应对与博弈,正成为新时代内容产业无法回避的核心挑战。本文将依次剖析技术驱动力、产业冲击与社会规则,力求勾勒出生成式AI重塑未来内容世界的全景图。

1 技术奇点,重塑娱乐边界

1.1 引言:从“观看”到“玩赏”的范式转移

长久以来,影视内容消费是一种单向、被动的体验。然而,生成式AI的浪潮正彻底改写这一规则。“可玩电视”(Playable TV)正从科幻概念走向现实,它模糊了创作者与消费者的界限,将观众从被动的“沙发土豆”转变为故事的积极参与者,引领娱乐进入一个“玩赏”的新纪元。

这场变革的核心,是一系列新兴AI平台的崛起。它们不再是仅生成零散视频片段的单一工具,而是集剧本构思、角色设计、动画渲染、语音合成、后期剪辑于一体的“一站式内容工厂”。用户只需输入一个简单想法,AI便能在数分钟内交付一集完整的、可供观看甚至二次修改的动画。这不仅意味着内容生产效率的指数级提升,更预示着一个创意民主化的新纪元。

本文将深入拆解最具代表性的平台与技术,探索它们如何工作,如何协同构成全新技术生态,以及如何共同构筑“可玩电视”的未来。

“可玩电视”特指基于生成式AI技术,实现叙事可控与实时编排的技术范式。它超越了预设分支的互动剧,也不同于玩家主导的游戏直播,而是强调AI在运行时根据用户输入,动态生成和调整内容,确保叙事的连贯性与一致性,同时提供高度个性化的体验。

“可玩电视”之所以能在当下成为现实,得益于多项关键技术的协同成熟:

(1) 多模态生成成熟:以Sora为代表的视频生成模型,显著降低了长镜头一致性与口型对齐的技术门槛,使得AI能够生成高质量、连贯的视听内容。

(2) 端到端工作流成型:从文本到可播片段的闭环生成管线开始成型,AI能够自动化完成从创意到成片的多个环节,大幅提升效率。

(3) 家庭大屏硬件与边缘算力支撑:现代智能电视和边缘计算设备的算力足以支撑低延迟的内容拼接与实时渲染,为流畅的“可玩”体验提供了硬件基础。

为便于读者理解,本文将涉及以下核心术语:

• 分支图:描述叙事路径和决策点的图谱。

• Shot List(镜头清单):详细列出每个镜头的画面、时长、内容等。

• 口型对齐:确保角色语音与唇部动作同步。

• 角色一致性:跨镜头保持角色外观、声音、行为的稳定。

• 风格卡:定义视觉、听觉等内容风格的参数集。

• 低延迟拼接:在极短时间内无缝连接不同内容片段。

• 版本化生成:对生成内容进行多版本管理和迭代。

1.2 新一代平台巡礼:AI如何成为“全能制片人”

近两年,一批专注于生成式内容和可玩电视的新平台集中涌现,它们的技术路径和产品形态,清晰地勾勒出内容创作的未来图景。这些平台通过集成多项AI能力,正在将传统上复杂、耗时、高成本的影视制作流程,转化为高效、智能、易用的自动化管线。它们不仅是工具的集合,更是内容生产模式的革新者,使得AI真正成为“全能制片人”。

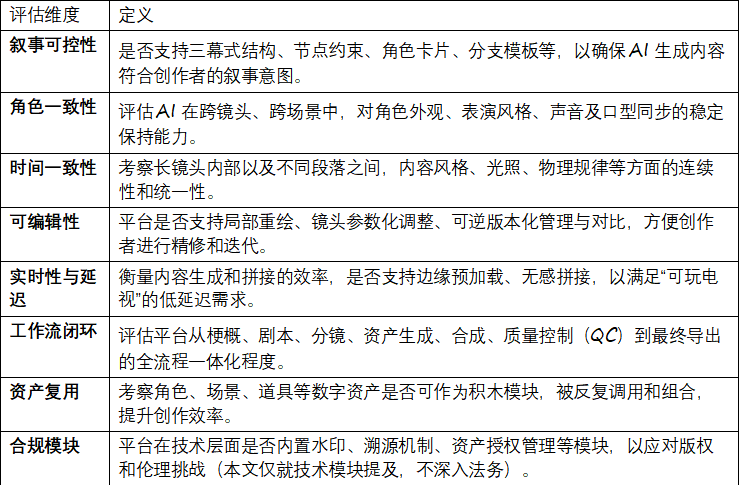

在深入探讨具体平台之前,我们先明确评估这些新一代生成式内容平台的关键维度,这些维度将贯穿后续的样本拆解:

表格-1 新一代生成式内容平台的关键维度。

三个最具代表性的样本进行详细拆解:Showrunner.ai、The Simulation以及Inworld与Scenario。它们分别对应着“全流程制片”、“世界模型构建”和“角色与资产引擎”三条核心技术线,互为补充,共同构建了可玩电视的技术基石。

1.2.1 Showrunner.ai:AI界的“Netflix”,一站式剧集生成器

由Fable Studio推出的Showrunner.ai,被业界冠以“AI界的Netflix”之名。其核心能力是专有的多模态大模型“SHOW-2”,能将自然语言提示转化为完整的动画剧集。〔参考:Fable Studio官方发布〕

其工作流程颠覆性:用户仅需描述故事,上传自拍照生成主角,SHOW-2模型便自动完成剧本创作、角色动画、语音合成、场景渲染与后期剪辑,最终在几分钟内输出可播放的动画短片。

在Showrunner的自动化流程中,创作者仍可在多个关键环节进行人为干预,确保内容符合预期:

• 大纲与人物设定:精修故事大纲和角色设定。

• 镜头清单:调整或指定AI生成的镜头景别、机位、运动轨迹。

• 台词语气:润色对话,调整情感表达。

Showrunner在维持角色一致性方面采用多维度策略:

• 外观一致性:通过预训练模型和风格锁定,确保角色在不同镜头、表情下的视觉元素稳定。

• 声音一致性:采用声纹识别和音色克隆技术,保证语音连贯性。

• 口型同步:利用先进的唇形同步算法,确保语音与口型动画精确匹配。

• 肢体表演:通过行为树或动作库,使角色肢体动作符合性格和情境。

不过,AI 生成目前仍存在一些 “失败模式”,例如在长镜头里,角色外观会出现漂移崩塌的情况,口型与语音存在滞后或错位问题,发丝、阴影等细节也存在不一致的现象。对应的修复手段有:局部重绘、时域补帧、口型再对齐。

Showrunner 着重强调低延迟的互动体验,其技术核心在于 “高概率分支预加载 + 播放端拼接”。具体而言,AI 会预判用户的选择,提前生成或加载相关内容,而播放端则能在极低延迟(数百毫秒内)实现内容的无缝拼接。

利用Showrunner制作一段3-5分钟可玩短片的简化流程如下:

(1) 输入核心梗概。

(2) 生成三版大纲,选择其一。

(3) 选定风格卡。

(4) 出镜头清单。

(5) 生成首版片段。

(6) 人工回填关键台词。

(7) 二次生成与优化。

(8) 口型/配乐对齐与导出。

Showrunner 的早期演示颇具代表性 — 一部虽未经授权、却风格酷似《南方公园》的 AI 剧集,在社交媒体上收获了近 8000 万次观看量。这一案例直观证明,“生成式剧集” 时代已然来临:粉丝能借助 AI 创作新故事,独立导演与编剧也可快速将创意构想转化为现实作品。

Showrunner 所倡导的 “可玩电视” 概念,更将影视体验从单向的 “观看” 升级为双向的 “互动娱乐”。观众不仅能续写故事线,还能把朋友 “植入” 剧集,与 AI 协作打造专属的个性化互动内容。由此,影视创作链条被重塑为 “AI 辅助 + 用户主导” 的新模式,传统意义上的观看者,也转变为可参与剧情设计的 “可玩创作者”。

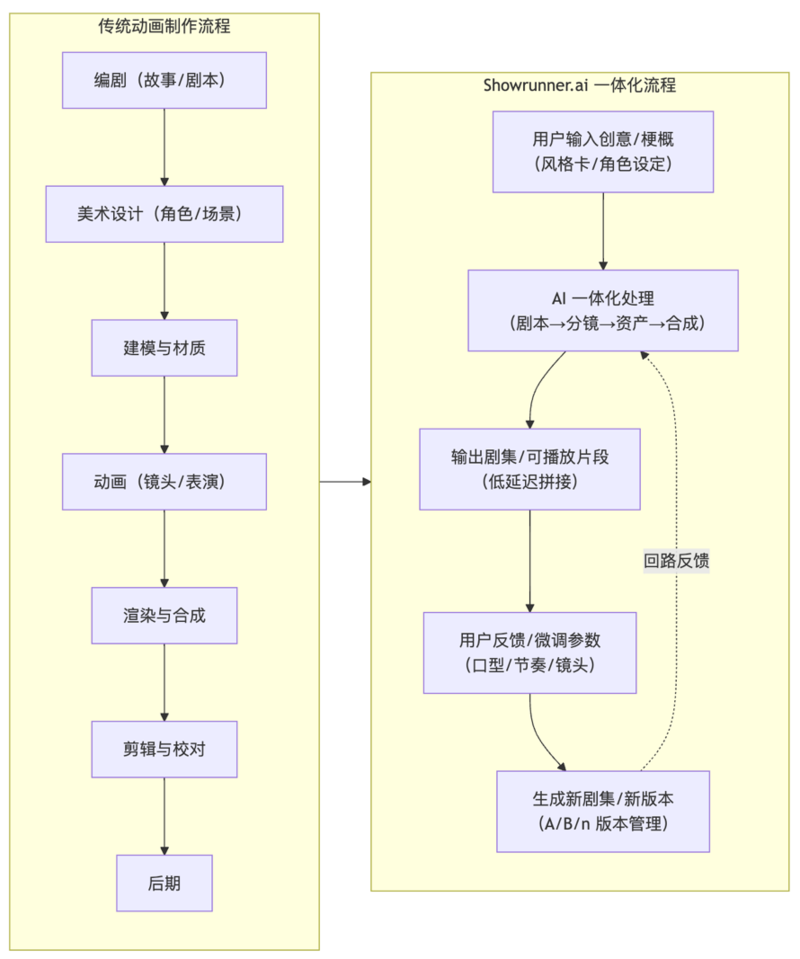

图-1 对比了传统动画制作的流程和AI流程的差别

1. 左侧传统流程:通过 7 个独立环节(编剧→设计→建模→动画→渲染→剪辑→后期)展示分步式工作模式,每个环节需专人完成,突出 “环节割裂”和“人工依赖” 的特点。

2. 右侧 AI 流程:以 “用户输入创意” 为起点,通过 “AI 一体化处理” 整合所有生产环节,直接输出剧集,并支持 “反馈 - 修改 - 再生” 的快速迭代,体现 “流程压缩”和“自动化”“高互动性” 优势。

图1

Fable Studio 已获得亚马逊等机构的投资,其首批推出的 10 部 AI 原创剧集支持二次创作。该公司 CEO 爱德华・萨奇(Edward Saatchi)坦言,AI 目前仍难以驾驭复杂的长篇叙事;但在结构化短篇剧集领域,AI 已展现出惊人的创作能力。

(未完待续......)

关联阅读:

责任编辑:李楠

24小时热文

流 • 视界

专栏文章更多

- [常话短说] 【重磅】广电人的重要时刻及拐点到来! 2025-09-03

- [金博士] 屏智未来|生成式内容与可玩电视(五) 2025-09-02

- [金博士] 屏智未来|生成式内容与可玩电视(四) 2025-09-02

- [金博士] 屏智未来|生成式内容与可玩电视(三) 2025-09-02

- [金博士] 屏智未来|生成式内容与可玩电视(二) 2025-09-02