2 月 18 日,昆仑万维宣布开源国内首个面向 AI 短剧创作的视频生成模型 SkyReels-V1、国内首个 SOTA 级别基于视频基座模型的表情动作可控算法 SkyReels-A1。

昆仑万维官方介绍称,SkyReels-V1 针对表演细节做了打标,还对情绪、场景、表演诉求等进行处理,利用“千万级别、高质量”的好莱坞级别数据进行训练微调。

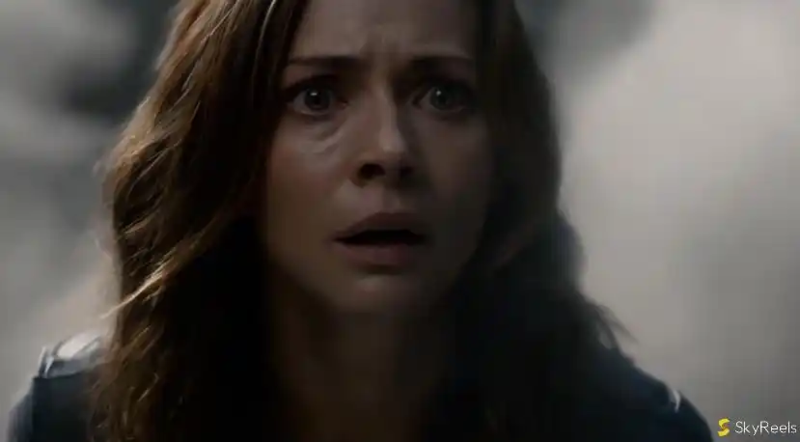

此外,SkyReels-V1 可实现“影视级人物微表情表演生成”,支持 33 种人物表情与 400 + 种自然动作组合,还原真人情感表达,支持生成大笑、怒吼、惊讶、哭泣等微表情。

基于好莱坞级的影视数据训练,当前 SkyReels 生成的每一帧画面,在构图、演员站位、相机角度等号称都具备“电影级的质感”。

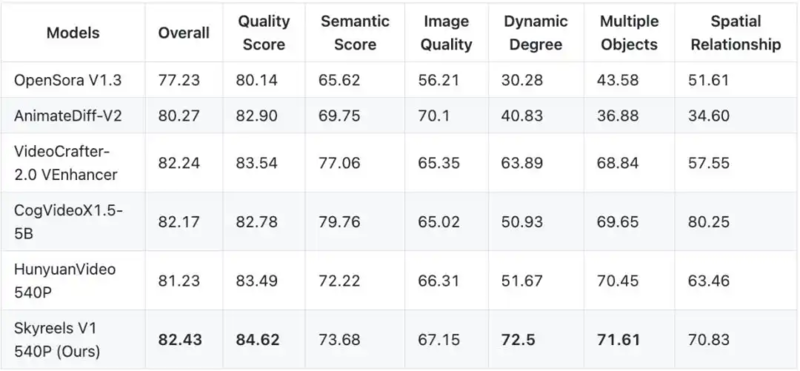

SkyReels-V1 不仅支持文生视频,还支持图生视频,号称是“开源视频生成模型中参数最大的支持图生视频的模型”,在同等分辨率下各项指标实现开源 SOTA。

总结来看,SkyReels-V1 可以实现:

影视化表情识别体系:11 种针对影视戏剧中的人物表情理解,如不屑、不耐烦、无助、厌恶等表情的理解;

人物空间位置感知:基于人体三维重建技术,实现对视频中多人的空间相对关系理解,助力模型生成影视级人物站位;

行为意图理解:构建超过 400 种行为语义单元,实现对人物行为的精准理解;

表演场景理解:实现人物-服装-场景-剧情的关联分析。

性能方面,在自研推理优化框架「SkyReels-Infer」的加持下,该模型可实现 544p 分辨率,推理基于单台 4090 用时 80s,还支持分布式多卡并行,支持 Context Parallel,CFG Parallel,和 VAE Parallel。

此外,模型采取 fp8 quantization 以及 parameter-level offload,满足低显存用户级显卡运行需求;支持 flash attention、SageAttention,模型编译优化等,进一步优化延迟;基于开源 diffuser 库,提升易用性。

为了实现更加精准可控的人物视频生成,昆仑万维还开源了 SOTA 级别的基于视频基座模型的表情动作可控算法 SkyReels-A1,对标 Runway 的 Act-One,SkyReels-A1 支持视频驱动的电影级表情捕捉。

SkyReels-A1 能够基于任意人体比例(包括肖像、半身及全身构图)生成人物动态视频。

如下图所示,将参考人物图片(上图)和驱动视频(左下)同时作为输入,在 SkyReels-A1 的能力加持下,生成了新的视频 —— 将驱动视频中的面部表情和表演细节“移植”到给定参考图片的人物身上。

开源地址如下:

SkyReels-V1:https://github.com/SkyworkAI/SkyReels-V1

SkyReels-A1:https://github.com/SkyworkAI/SkyReels-A1

技术报告:

https://skyworkai.github.io/skyreels-a1.github.io/report.pdf

责任编辑:房家辉

24小时热文

流 • 视界

专栏文章更多

- 见微知著|海南自贸港2025封关,短剧出海新坐标? 2025-04-23

- 短剧榜单|3月美妆短剧竞逐女神节,电商品牌领跑短剧营销 2025-04-18

- [常话短说] 【破局】异业合作、跨界经营,广电自救新招式?! 2025-04-16

- 见微知著|对话张若波:多年芒果系转身微短剧得与失 2025-04-16

- [常话短说] 【解局】2025具体怎么干?多省广电给出答案! 2025-04-14